Inteligencia Artificial

Seguridad

Policía

Reconocimiento facial

Policía predictiva

El boom de la inteligencia artificial está llegando de a poco a las fuerzas de seguridad de América Latina. Mientras algunos países dan sus primeros pasos, otros consolidan su uso, pero las regulaciones, en general, van por detrás. En este episodio, Juan Carlos Lara, de la organización de Derechos Digitales, nos cuenta sobre el caso de Chile, su policía predictiva y las cámaras de reconocimiento facial. Luego, Patricia Díaz, del laboratorio Datysoc, explica cómo el Ministerio del Interior de Uruguay creó un ecosistema de vigilancia al que ahora se le sumó un sistema de inteligencia artificial. Por último, Juan Diego Castañeda, de la Fundación Karisma, de Colombia, habla sobre cómo se usó la inteligencia artificial para perseguir a manifestantes durante las protestas de 2021 y analiza la situación de regulación en América Latina, Europa y Estados Unidos.

Créditos:

-

Producción

Bruno Scelza -

Edición

Silvia Viñas, Eliezer Budasoff, Daniel Alarcón -

Verificación de datos

Desirée Yépez -

Producción en redes sociales

Samantha Proaño, Natalia Ramírez, Juan David Naranjo -

Diseño de sonido y mezcla

Andrés Azpiri -

Música

Elías González -

Tema musical

Pauchi Sasaki -

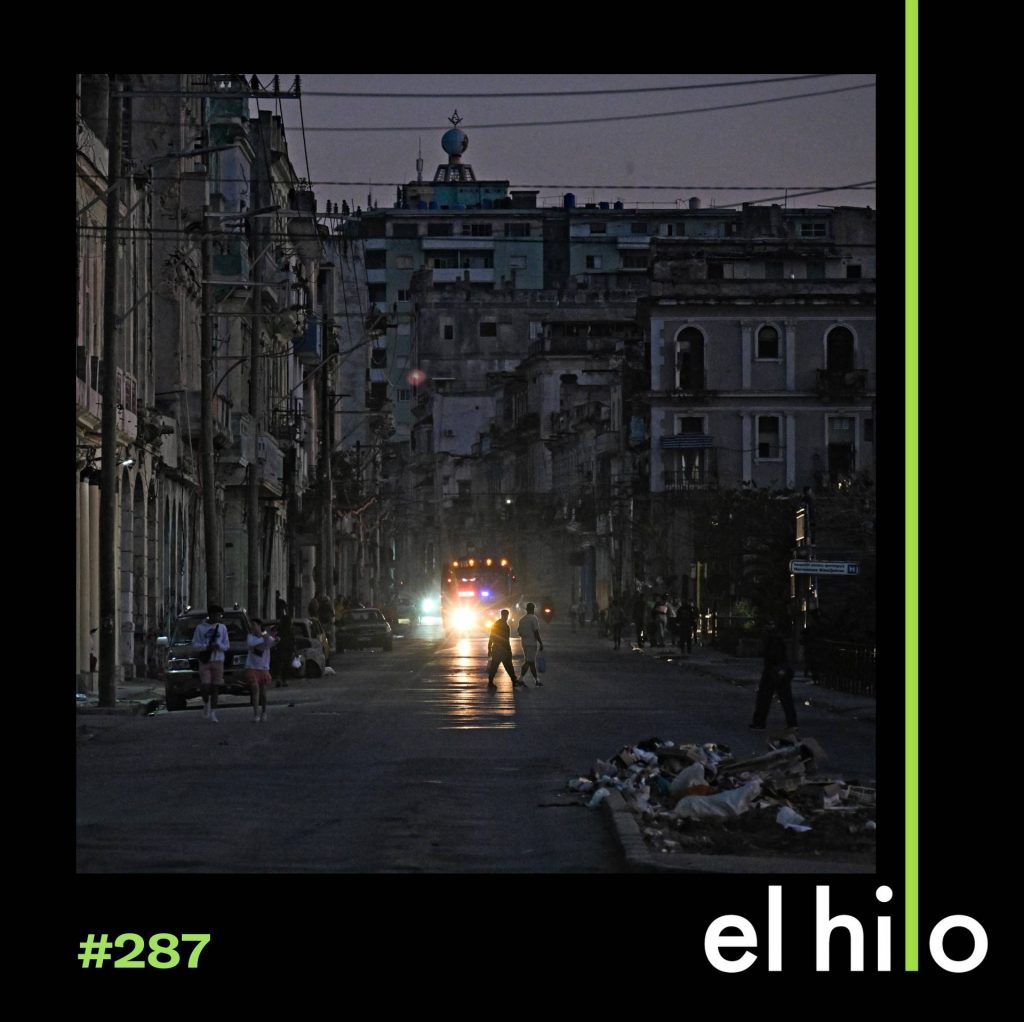

Fotografía

Getty Images / Vanderlei Almeida

Etiquetas:

Transcripciones:

Transcripción:

Silvia: Tal vez se acuerdan de la película Minority Report, o Sentencia Previa. Salió en 2002 y la dirigió Steven Spielberg. La trama es sobre un departamento de policía que logra detener los crímenes antes de que ocurran.

Eliezer: Más de 20 años después de su estreno, países como Estados Unidos, China o Países Bajos están usando un tipo de tecnología que se conoce como policía predictiva, potenciada con inteligencia artificial.

Silvia: Y, poco a poco, está llegando a América Latina

Archivo de audio: A la videovigilancia que ya tenemos desde hace años en la Policía Nacional, sumarle la inteligencia artificial que nos detecte mediante el estudio de los patrones de conducta de los delincuentes…

Silvia: Esta es una autoridad de la Policía de Uruguay en septiembre de 2024.

Archivo de audio: A la inteligencia artificial se le pidió que nos disparara alertas previo a consumar el acto delictivo y durante se consuma dicho acto.

Eliezer: En los últimos años, los gobiernos de diferentes países latinoamericanos incorporaron o empezaron a prepararse para integrar la inteligencia artificial a su policía para combatir el crimen. Pasó en Chile…

Archivo de audio: Es un sistema que permite mediante la inteligencia artificial poder alertar de situaciones muy particulares que están sucediendo en los barrios de los vecinos de Las Condes…

Silvia: En Argentina…

Archivo de audio: Nos enteramos en el boletín oficial que Patricia Bullrich había firmado una resolución en la que anunciaba la creación de esta unidad de inteligencia artificial aplicada a la seguridad.

Silvia: Y en Colombia.

Archivo de audio: Le he pedido al ejército y a la policía que creen las facultades al interior de las escuelas militares que tengan que ver precisamente con la sapiencia alrededor de la inteligencia artificial.

Eliezer: En todos los casos se ofrece una idea de eficiencia, como si la tecnología pudiera por sí misma mejorar la seguridad pública. Pero las experiencias de Estados Unidos y Europa nos dejan más preguntas que respuestas, y algunas advertencias….

Archivo de audio: Muchos distritos pobres pueden terminar siendo sobrevigilados porque el modelo predice que las tasas de criminalidad serán más altas allí.

Archivo de audio: El reconocimiento facial lo identificó como el sospechoso. Incluso la propia víctima le dijo a la policía que no era él.

Silvia Viñas: Bienvenidos a El hilo, un podcast de Radio Ambulante Studios. Soy Silvia Viñas.

Eliezer Budasoff: Y yo soy Eliezer Budasoff.

Silvia: Hoy, cómo América Latina, una región asolada por la violencia, integra la inteligencia artificial a sus servicios de Policía… Y cuáles son los riesgos cuando esta tecnología se usa con poca transparencia, y llega más rápido que su regulación.

Es 21 de febrero de 2025.

Eliezer: Una pausa y volvemos.

Silvia: Estamos de vuelta en El hilo. Nuestro verificador de datos, Bruno Scelza, viene siguiendo de cerca los impactos del boom de la inteligencia artificial en América Latina. Hace algunos meses quiso conocer qué tipos de inteligencia artificial ya están usando las fuerzas de seguridad en nuestra región. Vamos a empezar con Chile, porque fue uno de los primeros países en apoyarse en la tecnología para el trabajo de vigilancia policial. Y Unesco lo considera un país a la vanguardia en políticas para un uso responsable de la inteligencia artificial. Su experiencia tiene que ver con algo que vemos todos los días en las calles, en todos lados, y cada vez más: las cámaras de seguridad. Bruno nos sigue contando.

Bruno Scelza: Chile empezó a instalar cámaras de vigilancia a mediados de la década del 90. Después, en 2018, empezó a incorporar tecnologías de inteligencia artificial a sus sistemas de seguridad, como el reconocimiento facial en centros comerciales y otros espacios públicos…

Juan Carlos Lara: Y que se ha unido a la tendencia por poner más tecnología de videovigilancia, no solamente a través de cámaras fijas, sino también a través de drones o de globos.

Bruno: El es Juan Carlos Lara, codirector ejecutivo de la organización Derechos Digitales. Me dijo que además de esta vigilancia por cámaras y drones, la policía chilena lleva unos años usando tecnologías de predicción policial.

Juan Carlos: Esto es, tecnologías que mediante información con la que cuenta de la denuncia de delitos en ciertos lugares comienzan a priorizar el despliegue de policías en las calles para tratar de prevenir delitos dentro de los espacios que se reconocen como sensibles.

Bruno: Entonces, reconocimiento facial y policía predictiva. Juan Carlos me explicó que la mayoría de estas nuevas tecnologías están en zonas urbanas. Más que nada en Santiago, la capital, y en comunas cerca del centro.

Los programas piloto empezaron hace casi una década y, en 2023, el Ministerio de Seguridad presentó el Plan de Patrullaje Preventivo Inteligente. Para 2024, 63 de las más de 300 comunas del país estaban incluidas en este plan. El sistema usa la inteligencia artificial para identificar zonas más propensas a tener más delitos y trazar rutas de patrullaje basadas en esa información.

El caso de Chile es particular porque, a diferencia del resto de la región, que suele usar tecnología de Estados Unidos, China, y Europa, la policía colaboró con universidades locales para crear este sistema.

Juan Carlos: Además, entendiendo que desarrollos de software llevados adelante por universidades locales son de un costo considerablemente menor que el de tratar de comprar tecnología extranjera. Así que era visto desde esa perspectiva como un intento de modernización desde el esfuerzo nacional más que traer hasta acá tecnología foránea.

Bruno: Lo cual suena como algo positivo. Más adelante vamos a hablar sobre qué implica que la tecnología venga de otros países. Pero Juan Carlos resalta que, si estas tecnologías se desarrollan localmente y para eso usan fondos públicos, lo que hacen es financiar conocimiento para vigilar a la sociedad, y no para que la gente tenga mayor libertad de movimiento.

Chile no es el único país que está usando tecnologías de reconocimiento facial para tratar de mejorar la seguridad pública. Desde hace ya algunos años parece haber un consenso entre los gobiernos de América Latina sobre sus beneficios. Juan Carlos me explicó que para los gobiernos tiene, supuestamente, muchas “ventajas aparentes”.

Juan Carlos: Como que cada vez que nos encontramos con un discurso público que habla del reconocimiento facial, parece ser básicamente como una tecnología mágica que permite detectar de forma inmediata cuando exista un peligroso delincuente buscado en un lugar público, o bien que permite reconocer inmediatamente a una persona que acaba de cometer un delito.

Bruno: Pero, por supuesto, no es así como funciona. La otra ventaja sería que, supuestamente, con esta tecnología de reconocimiento facial podríamos darnos cuenta de qué está pasando en tiempo real, sin depender solo de que haya policías en el lugar del delito.

Juan Carlos: Y una de las grandes preocupaciones de seguridad pública que existe hoy está precisamente relacionada con que las policías no hacen su trabajo porque no están ahí. Entonces con todo eso ahí, es mucho más fácil para las autoridades, decir ‘esta es una herramienta útil’. Y también puede ser mucho más fácil para la gente entender que es una herramienta útil para la seguridad.

Bruno: Sin darse cuenta que está recopilando su información.

Juan Carlos me explicó que el reconocimiento facial funciona como un sistema de pesca de arrastre, cuando con una red los pescadores se llevan a varios peces y animales acuáticos a la vez. O sea, aunque la policía esté buscando a alguien específico, todas las personas que pasen delante de una cámara quedan registradas y no se sabe qué datos se les toman.

Juan Carlos: La principal preocupación que existe es una creciente invasión en nuestra vida por parte del aparato público. Es decir, podemos decir que no queremos que el Estado nos esté siguiendo. Y puede ser que en algún momento las personas reaccionen diciendo que puede ser por mayor seguridad, pero lo cierto es que no queremos tener un agente del Estado sobre nuestras cabezas, ni mucho menos que nos llegue un registro de dónde estuviste a cada momento.

Bruno: Y con el reconocimiento facial se crean esos registros todo el tiempo. Lo que le da a la policía la capacidad de saber dónde está una persona en cualquier momento.

Juan Carlos: Y eso es altamente peligroso porque normaliza que todas las personas sean vigiladas en todo momento solamente por el hecho de salir a la calle.

Bruno: Además, estas tecnologías vienen con sesgos desde su fabricación. Una inteligencia artificial es tan buena como los datos que procesa y la forma en que se diseñe ese procesamiento. Y un error de diseño puede convertirse en un sesgo.

Juan Carlos: La tecnología de reconocimiento facial es una tecnología que, como tal, puede fallar, y esa ha sido una de las grandes preocupaciones desde el mundo de los derechos humanos. Que una persona pueda ser mal identificada o confundida con otra cuando está andando por la calle y eso ha pasado en el mundo y se ha identificado incorrectamente a una persona y se le ha perseguido judicialmente y condenado incorrectamente.

Bruno: Pasó en 2020 en Detroit, Estados Unidos. La policía arrestó a un hombre afroamericano porque una inteligencia artificial de reconocimiento facial lo señaló como autor de un robo. El hombre era inocente, pero la inteligencia artificial había sido entrenada mayormente con rostros blancos.

Ese mismo año, se supo que más de 26.000 familias en Países Bajos, la mayoría de origen migrante, perdieron ayudas sociales porque una inteligencia artificial las señalaba como propensas a estafar al Estado. Cuando se descubrió el sesgo del sistema, el primer ministro renunció y el software fue declarado ilegal.

Juan Carlos: Y el problema del sesgo es que no solamente identifica mal a individuos, sino que identifica mal a grupos de individuos: personas negras, personas de tez ligeramente más oscura. Es muy probable que una tecnología de inteligencia artificial, de reconocimiento facial, que ha sido entrenada para reconocer a personas blancas se equivoque seriamente con personas negras.

Bruno: Según Juan Carlos, esto trae un par de consecuencias. La primera es que si una inteligencia artificial se equivoca con sesgos tan discriminatorios, se vuelve un peligro para cualquier persona racializada.

Juan Carlos: Pero también una segunda consecuencia que creo que no deberíamos olvidar cuando estamos hablando de los sesgos. Si esta tecnología llega a ser perfectamente operativa, si finalmente es tan exitosa que ya no tenemos que preocuparnos del sesgo o la discriminación, sigue siendo una tecnología tan potentemente, tan potente y tan invasiva que no importa que nos discrimine o no nos discrimine. Si se eliminan los sesgos, no deja de ser peligrosa. Y no podemos quedarnos en la superación de los sesgos o pedirle una mayor precisión técnica a una vigilancia que debería ser inaceptable para todos.

Eliezer: Después de la pausa vamos a Uruguay, que creó un ecosistema de vigilancia policial con tecnología y ahora intenta regular la inteligencia artificial.

Ya volvemos.

Silvia: Estamos de vuelta en El hilo.

Eliezer: Si bien Uruguay ha tenido una baja en las cifras oficiales de delitos durante los últimos años, siguen siendo números altos. Y se destacan porque son muy violentos.

Archivo de audio: Sonido de disparos. Irrumpieron en las canchas tres hombres armados y comenzaron a disparar contra un hombre que esperaba para jugar un partido de fútbol 7.

Archivo de audio: El joven de 22 años estaba yendo al almacén con su hija de dos años en brazos cuando dos hombres que pasaron en moto efectuaron una ráfaga de disparos.

Silvia: El 1 de marzo en Uruguay asumirá un nuevo presidente: Yamandú Orsi, del Frente Amplio. El partido de centroizquierda volverá al gobierno luego de cinco años de presidencia de Luis Lacalle Pou. La seguridad pública fue un tema central en la campaña de Orsi.

Archivo audio: El objetivo de la seguridad debe ser el de recuperar, recuperar el espacio que no se controla, recuperar la tranquilidad de los barrios, recuperar la paz social, recuperar la confianza.

Eliezer: Bruno nos sigue contando.

Bruno: En 2024 en Uruguay hubo más de 10 homicidios por cada 100.000 habitantes, más que en países de la región como Chile, Perú y Argentina. Y en la última década, las posibles soluciones a la inseguridad en Uruguay suelen venir con propuestas de nueva tecnología.

Patricia Díaz: Recuerdo la primera vez que vi una noticia que me llamó la atención relacionada con incorporación de tecnología para vigilancia automatizada por parte del Ministerio del Interior.

Bruno: Ella es Patricia Díaz. Es abogada especializada en derechos digitales y coordina el Laboratorio de Datos y Sociedad, Datysoc.

Patricia: Me llamó la atención esta tecnología que se llamaba Predpol, que era un sistema basado en un algoritmo de inteligencia artificial que recomendaba a la policía dónde desplegar los recursos de patrullaje. Lo que hacía era analizar la información que tenía disponible la policía y marcar zonas rojas, básicamente.

Bruno: Zonas rojas, es decir, lugares donde potencialmente ocurren más delitos. El Ministerio del Interior uruguayo usó Predpol entre 2014 y 2017, con la promesa de predecir dónde se cometerían delitos. Pero se dejó de usar porque una investigación demostró que había pocas diferencias entre el mapeo que hacían los policías basados en su experiencia y los resultados de Predpol.

Patricia: En cuestiones relacionadas con barrios pobres o marginales y en cuestión de eficiencia era bajísima. Pero esto es una muestra, una muestra de bueno, cómo es la dinámica que vamos a experimentar.

Bruno: El Ministerio del Interior uruguayo siguió incorporando tecnología. Compró un sistema para intervenir comunicaciones, un software de reconocimiento facial, uno que busca conexiones entre usuarios en redes sociales, otro que detecta disparos y, el más reciente, el que presentaron en septiembre de 2024.

Patricia: Es un software de análisis de movimiento, basado en inteligencia artificial que detecta teóricamente conductas delictivas, movimientos de personas en la vía pública, porque se supone que ese software está asociado a las cámaras de videovigilancia, que son miles.

Bruno: Según el Ministerio del Interior, hasta agosto de 2024 había 12 mil cámaras instaladas en todo el país. Eso es una cámara cada 291 personas. La mitad están en la capital, Montevideo, y unas 2.000 tienen este nuevo sistema. Funciona así: la inteligencia artificial detecta supuestos “patrones de conducta” cuando alguien pasa delante de las cámaras, envía una alerta y quienes monitorean las imágenes deciden si pedir policías en la zona o no.

Patricia: Y ahora vamos a ver, nosotros preguntamos muchas preguntas sobre cómo funciona, cuál es el alcance, la eficiencia y la respuesta es no podemos contestarte, por parte del Ministerio del Interior. Este último software es realmente una intriga de qué hace y cuáles son las consecuencias de hacer determinados movimientos en determinados barrios porque no sabemos qué es lo que detecta y cómo funciona.

Bruno: Patricia dice que el Ministerio del Interior uruguayo creó un “ecosistema de vigilancia” que tiene varios problemas.

Patricia: El principal es el trazado de líneas rojas, qué es lo que puede y qué es lo que no puede, no debería hacer.

Bruno: O sea, qué límites le ponen a la Policía para usar tecnologías, especialmente las de inteligencia artificial. Pero para poner esos límites se necesita regulación.

Patricia: En Uruguay estamos a foja cero, a foja cero en el sentido de que no solo no tenemos regulada el uso de la inteligencia artificial con fines de vigilancia policial, sino que tampoco tenemos ninguna normativa relacionada con prueba digital.

Bruno: La prueba digital es la información que se produce, se guarda o se transmite en medios electrónicos y se usa en un proceso judicial. Puede ser desde los datos de una foto que tomaste con tu celular a la información que recoge una cámara con reconocimiento facial. En Uruguay hay leyes sobre los documentos digitales pero nada que deje en claro qué puede ser tomado como prueba digital y qué no. En el Código del Proceso Penal uruguayo no hay menciones a la prueba digital, aunque, según Patricia, es muy probable que se vaya a usar en juicios.

Patricia: Y tenemos que entender si es admisible o no en un juicio y cómo un juez puede valorar la prueba que surja de un sistema automatizado de detección de movimiento, un match biométrico, técnicas de ciberpatrullaje y análisis de relación de personas en Internet. No tenemos regulada la vigilancia, la prueba digital y no tenemos formados a los actores del sistema jurídico. Entonces, son tres problemas que vienen en el mismo paquete y que tendríamos que estar poniéndonos urgente a trabajar.

Bruno: Este año los legisladores uruguayos tienen información para empezar a trabajar. A fines de 2024, se aprobó una Estrategia Nacional de Inteligencia Artificial para que se aplique en el Estado uruguayo hasta el 2030. El Laboratorio Datysoc, donde trabaja Patricia, participó en el desarrollo de esta política con aportes sobre seguridad.

Aunque la estrategia no tiene un apartado de seguridad pública porque fue muy difícil llegar a un acuerdo en este tema, sí propone acciones inmediatas para equilibrar los avances en el uso de IA en la seguridad pública y el impacto que pueda tener en los derechos de las personas.

Pero Patricia ve que hay un problema más grande que es independiente de las regulaciones: cómo se maneja la transparencia en la Policía uruguaya.

Patricia: No importa el color del gobierno en el que estemos. Existe un problema de cultura institucional, de secretismo a nivel Ministerio del Interior que no, no se ha solucionado con cambios de gobierno, cambios de partido. Esa cultura sigue arraigada.

Bruno: Patricia me explicó que Datysoc demandó al Ministerio del Interior dos veces y ganó en ambos casos, para que entregue información que habían declarado reservada sobre cómo y para qué se usan algunas tecnologías que tiene la Policía. Con el nuevo sistema de Policía predictiva también está faltando información.

Patricia: Cuando hablamos del funcionamiento del software de análisis estamos haciendo especulación pura, aviso, porque en ningún momento se explicó cómo funciona el software, solo se explicó que levantando las manos se pide auxilio. Se supone que hay que mirar a las cámaras y levantar las manos, pero que detectan acciones como estar vigilando a una víctima o acciones de violencia. La cuestión es que, ¿cómo se podría manejar –y ahí estamos en el campo de lo hipotético– el caso de una persona que tiene epilepsia o que está bailando, haciendo… O sea, las personas no están enteradas de cómo funciona el software y tampoco de cuáles son las consecuencias. El ciudadano tiene que saber cómo va a reaccionar la policía ante una alerta que saque ese software. Nada de eso se sabe. Lo único que tenemos es propaganda pura.

Bruno: Y según Patricia, ese va a ser uno de los grandes desafíos en seguridad para el gobierno uruguayo que entra, porque implica cambiar la cultura de la misma Policía y el Ministerio del Interior.

Patricia: Va a llevar tiempo un cambio en el sentido de transformar la cultura institucional, de secretismo y de resistencia a la rendición de cuentas que tiene la Policía. De cualquier manera, nosotros nos vamos a acercar a las autoridades en este nuevo gobierno, con otra mirada. ¿Por qué? Porque ya tenemos informes, porque ya tenemos… Este tema no es un tema que haya pasado debajo del radar. Este tema de la vigilancia automatizada es trendy a nivel mundo y a nivel nacional. Salieron muchas alarmas. Entonces, insisto, no tiene que ver con quien esté en el gobierno, sino que han sucedido cosas y que deberíamos estar en un momento en el que ya no se necesitan más alarmas. Necesitamos movernos hacia una regulación y creo que tenemos los antecedentes como para poder empezar a trabajar el tema desde la mirada regulatoria.

Eliezer: Después de la pausa, cómo avanza la regulación de estas tecnologías en el resto de la región. Ya volvemos.

Silvia: Estamos de vuelta en El hilo. Ya conocimos los casos de Chile y Uruguay, pero la inteligencia artificial en la policía es un cambio que está llegando poco a poco a toda la región, con diferentes niveles de regulación… Bruno nos sigue contando.

Bruno: El año pasado, Argentina creó una unidad de inteligencia artificial aplicada a la seguridad. En Paraguay, la policía empezó a probarla en estadios de fútbol. En Ciudad de México se está usando para detectar actividades delictivas en internet y en el control del tránsito. Mientras tanto, el presidente de El Salvador, Nayib Bukele, designó como asesor en inteligencia artificial a un empresario estadounidense e inició conversaciones con China por el uso que le dan a la IA en la seguridad pública.

Juan Carlos: Derechos Digitales lleva varios años trabajando en examinar despliegues en el ámbito público de tecnologías identificadas con la inteligencia artificial.

Bruno: De nuevo, Juan Carlos Lara.

Juan Carlos: Hemos llevado adelante diez casos de estudio en distintos países de la región para ver casos como los de chatbots o de entrega de ayudas estatales o del despliegue de policía predictiva también.

Bruno: La organización que dirige lideró un proyecto para estudiar cómo se implementó la inteligencia artificial en los gobiernos de Chile, Argentina, Colombia, Paraguay, México, Brasil y Uruguay. Juan Carlos dice que aunque los casos son diferentes, particulares a cada país, hay varios aspectos en común… Como la falta de transparencia, algo que nos mencionaba Patricia sobre Uruguay. También han encontrado que, usualmente, no se consulta a las personas que trabajan en áreas dedicadas a proteger datos personales, como las autoridades de los registros civiles.

Juan Carlos: O bien una falta completa de discusión o de análisis previos de impacto en derechos humanos. Y también es muy difícil encontrar allí que exista algún mecanismo de reclamo dedicado especialmente a esas tecnologías.

Bruno: Las tecnologías de inteligencia artificial en la región avanzan porque no hay leyes que las regulen… O simplemente se ignoran esas leyes.

Juan Carlos: Es un poco de moverse rápido y romper cosas. El avance en su implementación tiende a ser un proceso muchísimo más rápido, muchísimo menos sujeto a controles y muchísimo más implementado con ignorancia incluso de la población.

Bruno: Porque, según dice Juan Carlos, se ve a la tecnología como una solución del futuro: es como darle a entender a la población que la Policía trabaja con las mejores herramientas. Aunque no lo sean…

Juan Carlos: Aun si no son necesariamente útiles para su propósito o si tienden a barrer con un montón de preocupaciones legítimas sobre derechos fundamentales, sobre participación pública o incluso sobre democracia.

Bruno: Además, recordemos que la mayoría de los países de la región importan estas tecnologías… y ahí la transparencia se vuelve un problema mayor.

Juan Diego Castañeda: Yo creo que eso tiene que ver también con el contexto en el que recibimos la tecnología.

Bruno: Él es Juan Diego Castañeda, codirector de la Fundación Karisma, de Colombia.

Juan Diego: A diferencia de lo que puede estar pasando en Estados Unidos, en China o en Europa cuando los desarrollos son locales hay también una posibilidad mayor de escrutinio, mientras que lo que recibimos en nuestros países muchas veces es una herramienta que se desarrolla en otro lugar a través de un proveedor o de un intermediario.

Bruno: Cuando la tecnología viene del extranjero los países no reciben tanta información. No saben cómo se construyó ese servicio, cómo lo entrenaron, qué líneas rojas tuvieron en cuenta. Y no pueden hacerle cambios.

Juan Diego: Al sector privado que revende soluciones tecnológicas para seguridad también le conviene que la tecnología se presente como un actor mágico.

Bruno: Juan Diego recordó que durante las protestas en Colombia en 2021, el Ministerio de Defensa usó inteligencia artificial para recopilar información en redes sociales de los manifestantes. Luego la Fiscalía la usó para llevarlos ante la Justicia.

Juan Diego: En Colombia tradicionalmente la protesta, la manifestación pacífica, han sido estigmatizadas Y por eso mismo la perspectiva con la cual se incorpora tecnología en el trabajo de seguridad es una perspectiva de criminalizar, de atacar, más que de negociar, más que de efectivamente concentrarse en cosas que en las que hay un consenso sobre qué es, qué puede ser delictivo, criminal, que puede ser dañino para la sociedad. Entonces, la forma en la que se contratan las tecnologías, digámoslo así, los manuales técnicos con los que vienen estas tecnologías no son públicos. Y nosotros no conocemos usualmente los procesos por los cuales llegan a tomar esa decisión.

Bruno: En la región hay algunos proyectos que buscan que la inteligencia artificial se use con responsabilidad. Está la estrategia de IA de Uruguay, que mencionamos hace un momento. Chile tiene una Política Nacional de Inteligencia artificial y el año pasado se presentó un proyecto de regulación y también se está trabajando en algo similar en el Congreso de Colombia. Pero uno de los casos más relevantes es el de Brasil.

Archivo de audio: O plenário do Senado aprovou nesta terça-feira o marco regulatório para o uso da inteligência artificial no Brasil.

Archivo de audio: El uso de inteligencia artificial en infraestructuras de agua o electricidad, control fronterizo, administración de justicia, sistemas biométricos de identificación y otros son considerados de riesgo alto y serán objeto de mayor escrutinio antes de ser autorizados.

Bruno: En diciembre de 2024, el proyecto de ley fue aprobado en el Senado y pasó a Diputados. Propone crear una institución que se dedique a regular la inteligencia artificial y establece niveles de riesgo para diferentes usos de la tecnología en temas de seguridad. Está inspirada en la regulación de la Unión Europea.

Archivo de audio: La Unión Europea ya está lista para implementar su nueva ley de inteligencia artificial. Es considerada como la ley de IA más completa del mundo y sus creadores dicen que el enfoque está en proteger a los usuarios.

Bruno: Se aprobó en 2024 y este año empieza a implementarse de forma parcial. Lo más importante es que establece cuatro niveles de riesgo. El nivel uno es de riesgo mínimo y en el nivel dos están las aplicaciones que tienen que cumplir con reglas de transparencia, por ejemplo, los chatbots como ChatGPT o DeepSeek. El nivel tres es de alto riesgo y exige una regulación clara y estricta, porque es el que abarca los servicios públicos, desde la administración hasta la justicia.

Por último, en el nivel cuatro directamente se prohíben algunos usos de la inteligencia artificial. Por ejemplo, que la policía identifique a personas por biometría, o sea el escaneo de retinas, iris y otros rasgos físicos. También prohíbe que la policía use IA para predecir el riesgo de que alguien cometa una infracción. Esa regulación, la de mayor riesgo, es la que entró en vigencia este año.

Juan Diego: El panorama de regulación ha cambiado un poco desde la subida de Trump al gobierno de los Estados Unidos, porque llevó todo el problema regulatorio al problema de competencia.

Bruno: De nuevo Juan Diego Castañeda, de la Fundación Karisma. Me explicó que Trump decidió priorizar que las empresas compitan por el desarrollo de la IA, dejando de lado las regulaciones.

Juan Diego: Y pues, acompañado de las cabezas de las grandes empresas de tecnología en el mundo, pues claramente hay como un mensaje de desregulación que es no hacer nada desde el Estado y permitir que las empresas hagan lo que consideren que deben hacer de acuerdo a las presiones e intereses que que reciban.

Bruno: Una de las primeras medidas que anunció Trump fue una inversión privada de 500 mil millones de dólares para desarrollar infraestructura de inteligencia artificial a través de Stargate, una compañía creada por OpenAI, Oracle y la japonesa SoftBank.

En la Cumbre de Acción sobre Inteligencia Artificial, que se hizo a principios de febrero en París, quedaron claras las diferencias sobre el futuro de la industria. Mientras los países de la Unión Europea se posicionaron a favor de una mejor regulación que priorice la ética y la sostenibilidad, Estados Unidos estaba en la otra vereda. Este es el vicepresidente estadounidense, James David Vance, durante la cumbre:

Archivo audio: J.D. Vance: The Trump administration is troubled by reports that some foreign governments are considering tightening the screws on US tech companies with international footprints.

Bruno: Vance dijo que el gobierno de Trump está preocupado porque algunos países extranjeros están considerando “apretar las tuercas” a las empresas tecnológicas estadounidenses. Y que Estados Unidos no lo aceptará porque cree que es un error. Vance también dijo que una regulación excesiva de la IA podría matar a una industria en pleno crecimiento.

Archivo de audio: Now, America cannot and will not accept that and we think it’s a terrible mistake not just for the United States of America, but for your own countries.

Silvia: Más de 60 países participaron de la Cumbre de París, que reunió a gobiernos, organizaciones de la sociedad civil, académicos y empresas. Trataron cinco temas principales: el interés público, el futuro del trabajo, innovación y cultura, la confianza en la IA y la gobernanza mundial.

Eliezer: Al cierre de la cumbre presentaron una declaración pidiendo que el desarrollo de la inteligencia artificial sea abierto, inclusivo, ético y sostenible. También piden evitar que el mercado de la IA esté concentrado en unos pocos participantes. Los países que hemos mencionado en este episodio: Chile, Uruguay, Colombia y Brasil, firmaron la declaración. México también. Estados Unidos y el Reino Unido no firmaron.

Bruno: Este episodio fue producido por mí, Bruno Scelza. Lo editaron Silvia, Eliezer y Daniel Alarcón. Desirée Yépez hizo la verificación de datos. El diseño de sonido es de Andrés Azpiri, con música de Elías González y Andrés.

Agradecemos a Inés Guzmán y al programa de tutoría “Informar sobre la ética de la IA y los derechos digitales” de la Thomson Reuters Foundation. También a Maricarmen Sequera y Laura Hernández por su ayuda en este episodio para comprender la región.

El resto del equipo de El hilo incluye a Daniela Cruzat, Mariana Zúñiga, Nausícaa Palomeque, Samantha Proaño, Paola Alean, Camilo Jiménez Santofimio, Juan David Naranjo Navarro, Elsa Liliana Ulloa, y Natalia Ramírez. Daniel Alarcón es nuestro director editorial. Carolina Guerrero es la CEO de Radio Ambulante Studios. Nuestro tema musical lo compuso Pauchi Sasaki.

El hilo es un podcast de Radio Ambulante Studios. Si valoras el periodismo independiente y riguroso, te pedimos que te unas a nuestras membresías. América Latina es una región compleja y nuestro periodismo necesita de oyentes como tú. Visita elhilo.audio/donar y ayúdanos con una donación.

Si quieres abrir el hilo para informarte en profundidad sobre los temas de cada episodio, y enterarte de las noticias relevantes de América Latina y la comunidad hispana en Estados Unidos, puedes suscribirte a nuestro boletín de correo entrando a elhilo.audio/boletin. Lo enviamos cada viernes.

También puedes seguirnos en nuestras redes sociales. Estamos en Instagram, X, BlueSky, Facebook y Threads. Nos encuentras como @elhilopodcast. Déjanos allí tus comentarios y etiquétanos cuando compartas los episodios.

Gracias por escuchar.